На конференції AI SEO Day Сергій Кокшаров розповів про те, як SEO-спеціалісту створити свого простого AI-агента, автоматизувати рутинні процеси та перейти від ручного аналізу до системної роботи з даними.

Чому SEO сьогодні неможливе без автоматизації

Останні кілька років SEO змінилося радикально. Ми більше не працюємо лише з позиціями та оптимізацією сторінок. Ми працюємо з потоками даних.

Google Search Console генерує тисячі рядків запитів і URL. GA4 дає поведінкові сигнали. Ahrefs і Serpstat додають інформацію про лінки та конкурентів. Screaming Frog — технічний стан сайту. Паралельно з’являються AI-відповіді у видачі, нові канали трафіку, зміни алгоритмів.

Кожен із цих каналів створює інформаційний шум. І основна проблема не в тому, що даних мало — їх занадто багато. Людина фізично не встигає регулярно аналізувати все вручну.

Саме тут з’являється потреба в AI-агентах.

Читайте також: Битва за ранжування: Google проти AI контенту

Що я називаю AI-агентом

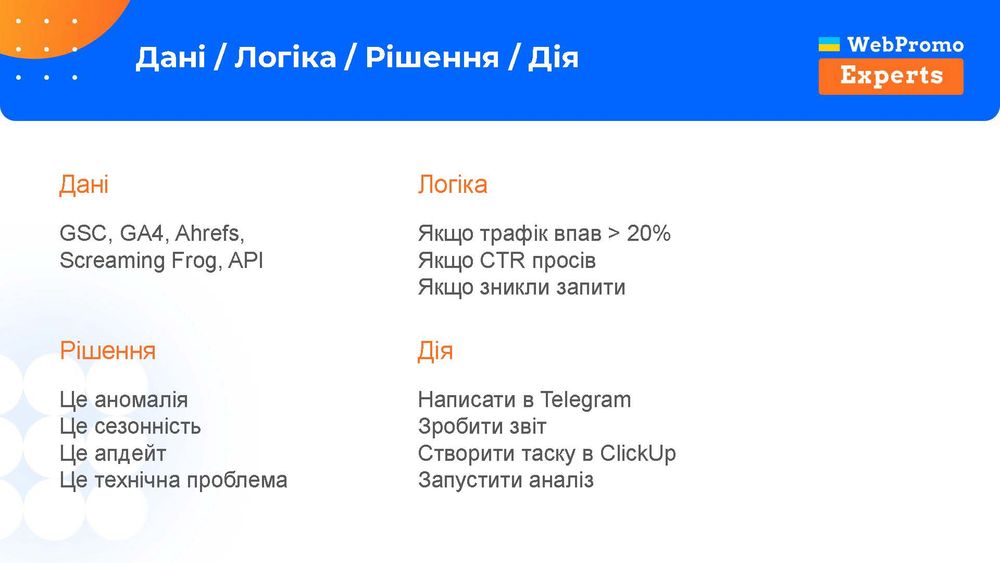

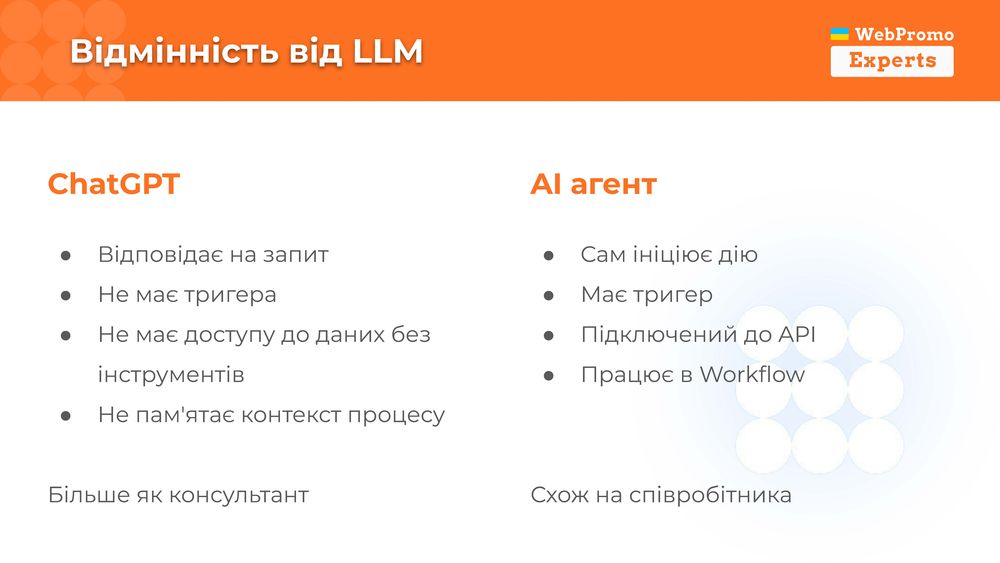

AI-агент — це система, яка працює в логіці процесу. Вона отримує дані, аналізує їх за заданими правилами, приймає рішення і виконує дію.

Ключове слово — дія.

Якщо ChatGPT відповідає на запит, то AI-агент ініціює процес. У нього є тригер — щоденний, щотижневий або подія. Він підключений до API сервісів. Він працює в рамках workflow. Він може самостійно надіслати звіт, створити задачу або попередити про проблему.

Тобто це не консультант, а співробітник.

Базова модель роботи SEO-агента

Будь-який агент будується за простою логікою:

- Отримати дані.

- Проаналізувати їх за правилами.

- Зробити висновок.

- Виконати дію.

На практиці це може виглядати так: агент отримує дані з GSC за останній тиждень. Перевіряє, чи впав трафік більш ніж на 20%. Якщо так — аналізує, які саме сторінки дали просідання. Далі формує короткий звіт і надсилає його в Telegram.

На це вручну SEO-фахівець витратив би 20–30 хвилин. Агент робить це автоматично.

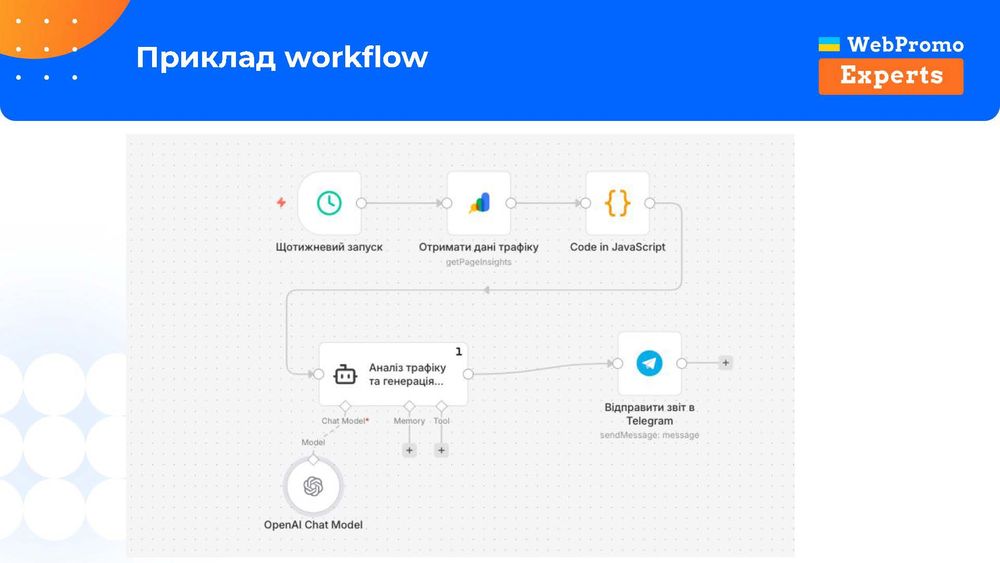

Кейс 1. Щотижневий моніторинг падіння трафіку

Перший реальний кейс — базовий агент для контролю трафіку.

Проблема: більшість SEO-фахівців дізнаються про падіння трафіку із запізненням. Часто це відбувається під час місячного звіту або після питання від клієнта.

Рішення: автоматизований щотижневий аудит.

Як це працює:

- агент запускається щопонеділка;

- отримує дані з Google Search Console через API;

- порівнює поточний період із попереднім;

- визначає значущі відхилення;

- формує текстовий звіт;

- надсилає його в Telegram або Slack.

У звіті я бачу не просто цифри, а інтерпретацію: які розділи просіли, де зросли покази без кліків, чи є аномальні зміни.

Це економить час і зменшує ризик пропустити проблему.

Від редакції. Як зрозуміти, чи бачать LLM ваш бренд? Семінар із Сергієм Кокшаровим — про те, як вимірювати видимість бренду, створювати власні трекери на базі API ChatGPT та n8n і автоматизувати аналітику без залежності від зовнішніх сервісів

Кейс 2. Контроль нових лінків і аномальної активності

Другий кейс — моніторинг лінкової маси.

У класичному підході ми періодично заходимо в Ahrefs або Serpstat і перевіряємо нові беклінки. Але в динамічних нішах цього недостатньо.

Я налаштував агента, який:

- отримує нові лінки через API;

- групує їх за типом;

- визначає, чи є сплеск нетипових доменів;

- формує короткий звіт наприкінці дня.

Якщо з’являється аномальний приріст підозрілих посилань, я отримую сигнал одразу, а не через місяць.

Такий агент працює стабільно, бо він використовує структуровані дані через API. У подібних сценаріях ризик «поломки» мінімальний.

Кейс 3. Автоматичний аналіз нових сторінок

Ще один приклад — контроль якості нових сторінок.

На великих проєктах часто додаються десятки або сотні URL. Не завжди є час перевірити кожну вручну.

Агент може:

- отримувати список нових URL із sitemap або CMS;

- перевіряти наявність title, description, H1;

- аналізувати довжину контенту;

- формувати звіт із проблемами.

У результаті я отримую не загальну статистику, а конкретний список сторінок, які потребують доопрацювання.

Які інструменти для цього використовувати

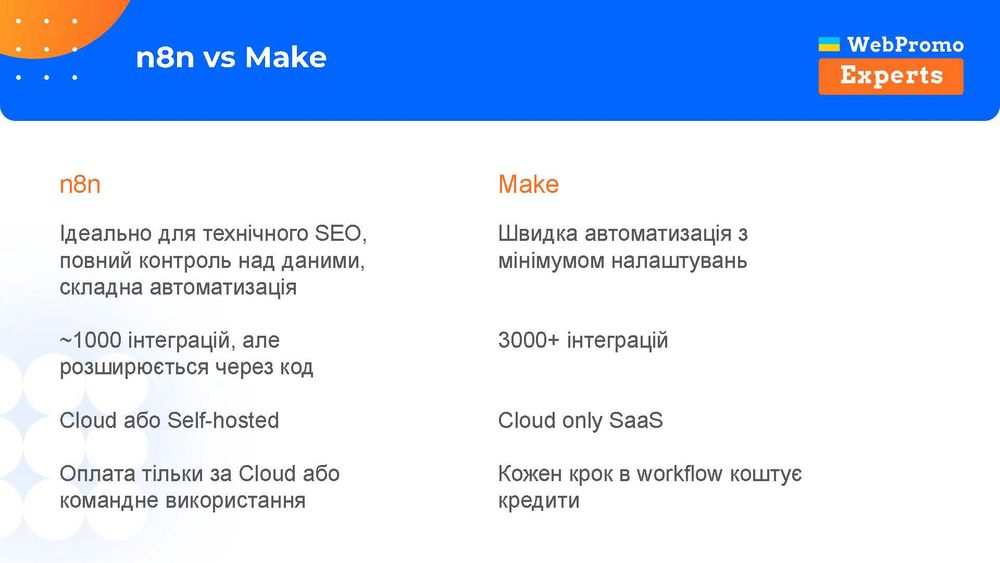

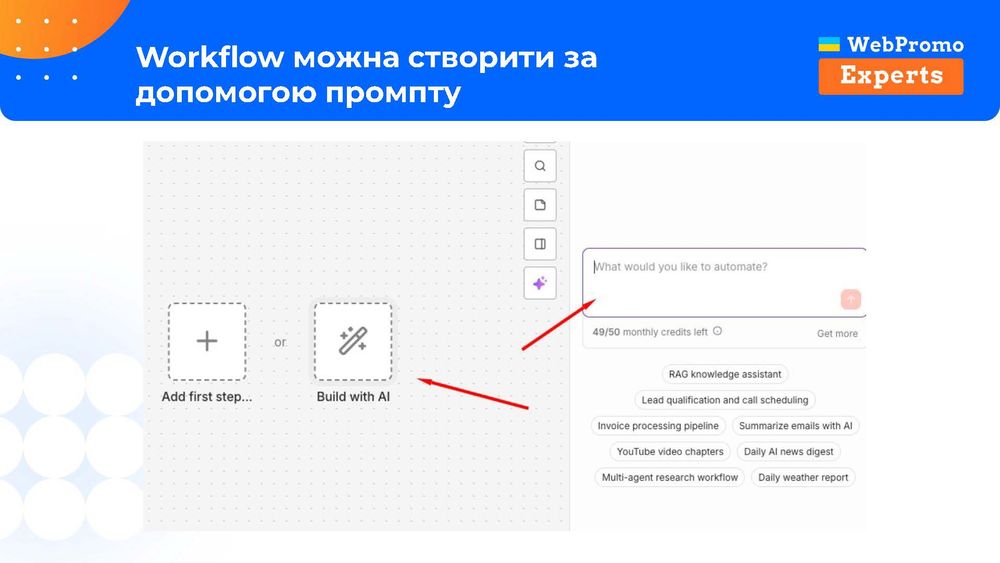

Для побудови таких агентів я найчастіше використовую n8n. Він дає повний контроль над логікою та даними, дозволяє працювати з API та масштабувати процеси.

Make також підходить для швидких сценаріїв, але при складних workflow або великій кількості кроків його модель із кредитами стає менш зручною.

Важливо розуміти: інструмент — це лише оболонка. Основна цінність — у правильно продуманій логіці.

Кейс 4. Автоматичний аналіз конкурентів і змін у видачі

Один із найцікавіших сценаріїв — це аналіз конкурентів у напівавтоматичному або повністю автоматичному режимі.

У класичному підході SEO-спеціаліст періодично перевіряє, хто з’явився в топі, які сторінки витіснили його проєкт, які формати контенту почали ранжуватися. Це займає час і часто робиться нерегулярно.

AI-агент дозволяє зробити це системно.

Логіка може бути такою: агент отримує список ключових запитів, знімає видачу через API (наприклад, DataForSEO або інші SERP-сервіси), фіксує зміни у топ-10 і порівнює їх із попереднім періодом.

Якщо в топі з’являється новий домен або різко зростає позиція певного конкурента, агент формує короткий аналітичний висновок. Наприклад: «У запитах комерційного кластера зросла частка маркетплейсів» або «У топ почали виходити довші гайд-матеріали замість коротких статей».

Це вже не просто моніторинг, а регулярна стратегічна аналітика.

Я використовую такі звіти для перевірки гіпотез: чи змінюється формат контенту у видачі, чи з’являється новий тип конкурентів, чи впливають AI-відповіді на клікабельність.

Кейс 5. Генерація та публікація контенту через workflow

Окремо варто поговорити про автоматизацію контенту. Тут важливо одразу зробити застереження: я не підтримую «безконтрольну генерацію».

AI має бути інтегрований у процес, а не замінювати його повністю.

Один із робочих сценаріїв виглядає так:

SEO-спеціаліст передає агенту ключове слово або тему. Агент аналізує видачу, визначає структуру сторінок у топі, формує чернетку структури статті. Далі створюється драфт тексту. Після цього матеріал автоматично завантажується в CMS як чернетка та відправляється редактору на перевірку.

Редактор працює з уже структурованим матеріалом, а не з порожнім документом.

У такому підході AI не забирає контроль, а прискорює підготовчий етап. Найбільший виграш — у часі на ресерч і структурування.

На великих проєктах це дозволяє масштабувати виробництво контенту без пропорційного збільшення команди.

Типові помилки при створенні AI-агентів

Коли SEO-фахівці починають працювати з агентами, я найчастіше бачу три помилки.

Перша — спроба автоматизувати все одразу. Люди намагаються побудувати складну систему з десятками сценаріїв. У результаті отримують нестабільний workflow, який складно підтримувати.

Друга — відсутність чіткої логіки. Якщо не визначено конкретний тригер і конкретну дію, агент перетворюється на хаотичний набір експериментів.

Третя — сліпа довіра до моделі. AI може помилятися в інтерпретації. Тому перші кілька тижнів будь-який агент потрібно тестувати вручну та коригувати промпти.

Найкращий підхід — почати з одного простого сценарію. Наприклад, автоматичного моніторингу падіння трафіку. І лише після стабілізації додавати складніші процеси.

Чи можна довіряти AI у стратегічних рішеннях

AI-агенти чудово працюють із рутинними задачами: моніторинг, збір даних, базова аналітика. Але стратегічні рішення все ще залишаються за людиною.

Я використовую AI для підготовки аналітичної бази. Він допомагає швидко побачити відхилення, структурувати інформацію, виділити тенденції. Але фінальний висновок роблю я.

Це важливо: AI не замінює мислення. Він зменшує час на підготовку до нього.

Як не втратити контроль, делегуючи рутину AI

Коли ми передаємо частину процесів агентам, виникає страх втрати контролю. Насправді контроль зберігається, якщо виконуються три умови.

По-перше, прозора логіка. Ви чітко розумієте, які дані обробляються і які правила застосовуються.

По-друге, тестування. Будь-який новий агент проходить період ручної перевірки.

По-третє, обмеження ролі AI. Він виконує рутину, але не визначає бізнес-стратегію.

У такій моделі AI стає частиною системи, а не джерелом хаосу.

SEO у 2026 році: керування системою, а не сторінкою

Пошук стає багатоканальним. Користувачі отримують відповіді не лише з класичної видачі Google, а й із AI-систем, маркетплейсів, форумів, агрегаторів.

SEO більше не зводиться до оптимізації сторінки під ключове слово. Воно перетворюється на управління складною екосистемою сигналів.

У такій реальності фахівець, який працює лише вручну, програє швидкості. А фахівець, який будує систему автоматизації, отримує конкурентну перевагу.

AI-агент — це не модний інструмент. Це спосіб масштабувати свою ефективність.

Резюмуємо. З чого почати

Я рекомендую почати з простого сценарію: налаштувати автоматичний щотижневий звіт із Google Search Console або моніторинг різких змін трафіку.

Після цього — додати контроль лінків або аналіз нових сторінок. Крок за кроком ви вибудуєте власну систему.

Найважливіше — не інструмент і не модель. Найважливіше — логіка процесу.

SEO майбутнього — це не спеціаліст, який витрачає години на ручну перевірку таблиць. Це спеціаліст, який будує workflow, де AI працює на нього.

Авторизуйтесь , щоб залишати коментарі