На початку зародження SEO, у 2000 роках майже кожний крок оптимізації створювався вручну. В той час, наприклад багато хто перевіряв вручну позиції сайту або аналізував статистику. Зараз більшість таких функцій автоматизовано великими компаніями по типу Ahrefs, Semrush або Serpstat. І якщо ви працюєте в SEO агентстві, то скоріше всього ви використовуєте один з цих сервісів. Але якщо ви не в агентстві, а inhouse працівник або фрілансер — то скоріше всього ви використовуєте більш недорогі та автономні рішення.

Для початку познайомимося. Я — senior seo спеціаліст Євген Молдовану, спеціалізуюся на entity-based seo та роботі з інтентом у складних нішах категорій EEAT та YMYL.

Ідея оптимізації свого часу обов'язково з'явиться у кожного оптимізатора.

Перш ніж це починати, проаналізуйте:

- Що найбільше у вас забирає часу?

- Які рутинні задачі вам не подобаються?

- Чи можлива автоматизація, або чи є якісь джерела даних які могли б вам в цьому допомогти?

- Якщо автоматизація можлива, то наскільки великий шанс помилки програмного забезпечення?

Наприклад більшість роботи з сайтом можливо автоматизувати в Screaming Frog. Це програмне забезпечення є майже у 90% seo оптимізаторів. Незважаючи на дуже великі оновлення останній час, більшість використовує його щоб подивитися 404, 403 помилки або 301 редіректи. В той же час там можна налаштовувати кастомний парсинг даних, аналіз параметрів або навіть аналізувати дані за допомогою AI. До речі непоганий мануал роботи з Custom Search публікував Сергій Кокшаров.

Також є різниця у інструментах в залежності від рівня seo оптимізатора. Якщо у джуна задачі пов’язані з семантикою, лінками або оптимізацією, то мідл займається більш розгалуженими завданнями, як то аудити, контроль виконання поставлених задач для програмістів, копірайтерів. У senior seo задачі більш стратегічні, як то розробка стратегій, контроль всього процесу. Тому для кожного типу задач можуть бути цінні різні інструменти.

Я хочу описати ті інструменти, які використовую я не періодично, а без яких я уже просто не уявляю свою роботу.

Тому мої інструменти підійдуть здебільшого для senior seo спеціалістів, які займаються аудитом сайтів і пошуком помилок які заважають повноцінно ранжуватися і бути в топі. Скрипти розбиті на підтеми для кращого сприйняття.

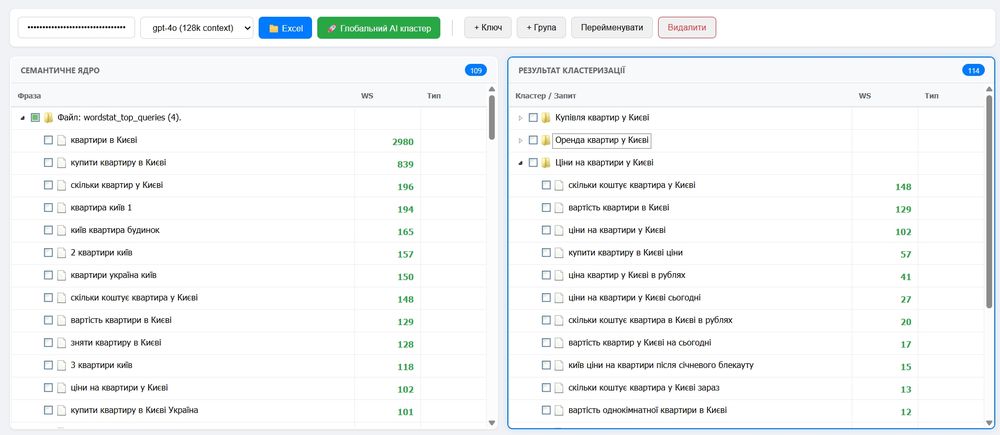

Кластеризація

Для кластеризації використовую як стандартний метод — по видачі (що роблять майже всі), так і інші авторські методи, як то наприклад проміжний метод кластеризації для завантаження в ШІ:

Це робиться за допомогою нейронних BERT подібних мереж. Ціль такої роботи (розбиття на топіки) — економія токенів API GEMINI, де набір ключових слів спочатку розбивається на групи, а потім окремо передається в ШІ. Це збільшує точність кластеризації, вирішує частково проблему обмежень на відповіді від ШІ (8000 токенів в даний момент).

Далі вже окремі результати додатково кластеризуються за допомогою безкоштовного API GEMINI, а потім, якщо в цьому є потреба — докластеризовується вручну:

Аналіз тексту

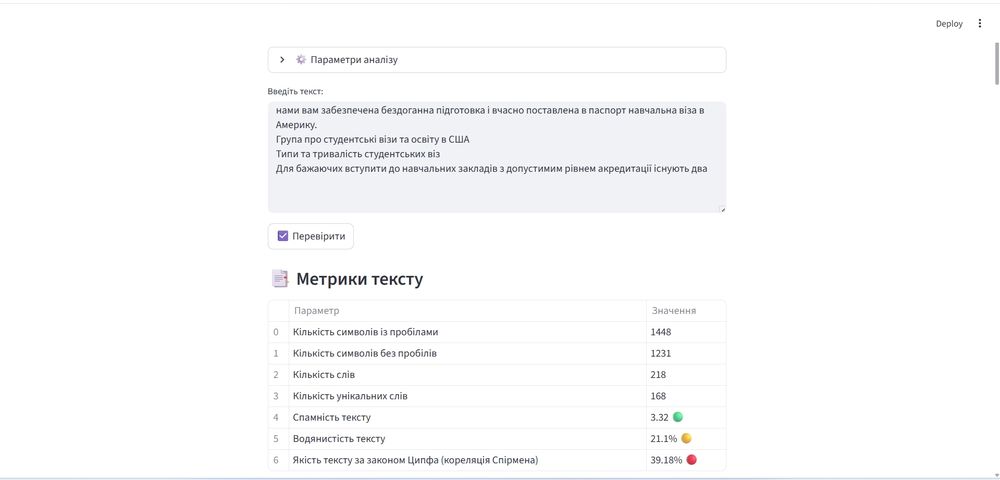

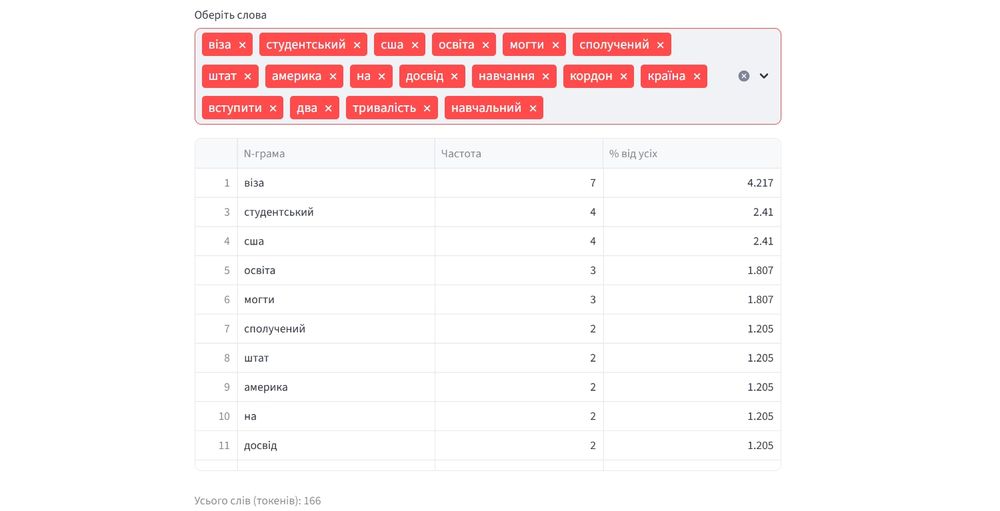

Перше що треба автоматизувати — це перевірку тексту на стандартні показники, як то спамність, водянистість, кількість символів. Чому би не використовувати стандартні сервіси, яких в інтернеті багато? Проблема в тому, що вони не завжди правильно рахують показники для українського тексту, не мають словників, а ще гірше - неправильно рахують спамність. Наприклад, я використовую для перевірки за законом Ципфа інший коефіцієнт (рангову кореляцію Спірмена), що дозволяє точніше визначати якість тексту.

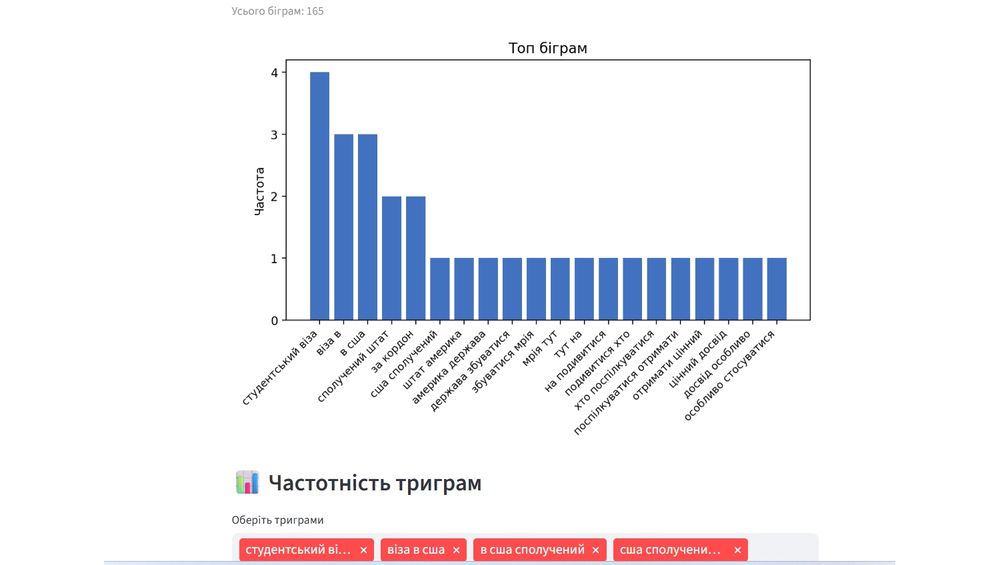

Також окремо аналізую уніграми, біграми та триграми. Перевага мого сервісу від публічних — це можливість не просто видалити стоп слова, яких немає у словнику, але й автоматично без оновлення перерахувати показники. Тут стоп слова на скриншоті додані для розуміння, звісно основні слова є у словнику.

Всі дані також візуалізуються, створюються хмари слів і графіки.

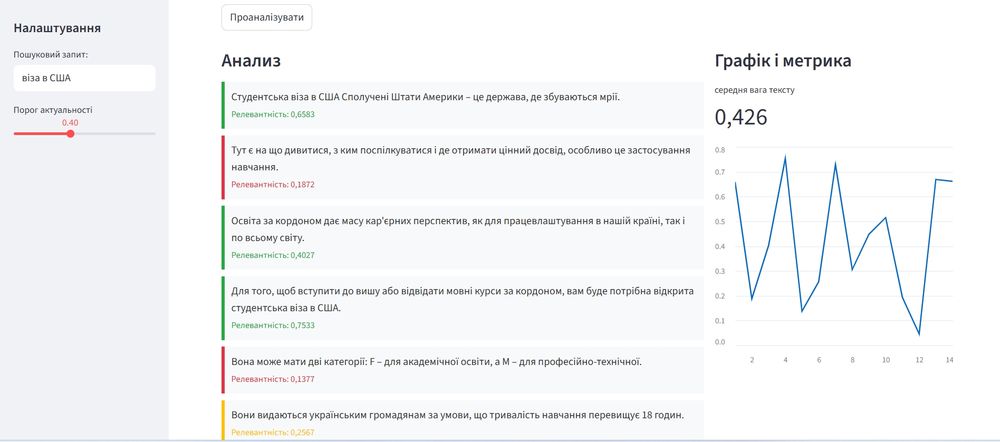

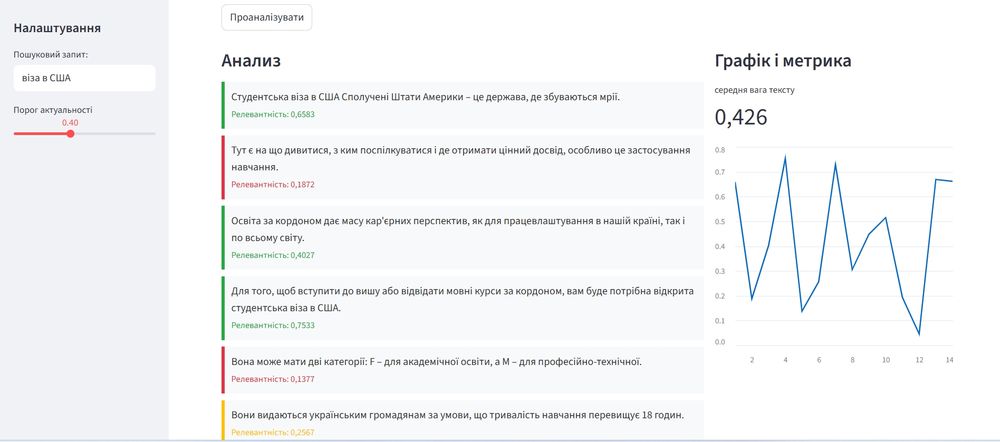

Також є сервіс який візуалізує текстову релевантність за допомогою BERT (запит-текст статті), що допомагає бачити речення з водою (зверніть на 2 речення):

Користуючись такими сервісами треба розуміти, що низька релевантність якоїсь частини тексту — це не завжди погано, якщо там розкривається щось важливе. Також падіння релевантності ближче до кінця - це не просто норма, а так і повинно бути.

Аналіз сайту

Для аналізу сайтів я використовую Screaming Frog. Але є й окремі функції які я переніс на свої скрипти.

Це функціонал:

- Парсингу даних. Я використовую свої розробки для парсингу текстів з різних сайтів для обрахунку і отримання слів які задають тематику, порівняння свого сайту і статей.

- Пошуку доменів для PBN. Це окремі скрипти, які сканують старі сайти яким більше 10-15 років для отримання посилань з них і їх перевірки через RDAP (новий Whois ) на доступність до реєстрації.

- Перевірка швидкості сайту по PageSpeed Insights. Скрипти по розкладу рахують по API показання ключових метрик Core Web Vitals (LCP, CLS, INP, FCP). І як падіння, так і зростання значень більше чим N — це вже проблема. Тому що якщо прилетіло значення 100 для сторінки де максимум було 70 - скоріше всього щось сталося з кешованою версією сторінки, вилетіла 404, помилка сервера або блокування хостингу.

- Окремі скрипти моніторингу. У мене це скрипти які не розташовані на хостингу, а знаходяться на окремих CDN, як приклад GitHub або Google Apps Script. Такі сервіси по крону і таймеру відстежують важливі показники або перевіряють парсинг даних. Приклад — парсинг позицій сайту або перевірка чи працює мій скрипт парсингу валют.

Сутності

Сутності в seo — це найактуальніша тема, тому треба контролювати закриття всіх інтентів для запиту. Тут я використовую усе — як окремі API, так і стандарті дані з WikiData i Google Knowledge Graph.

До прикладу ось аналіз сутностей за допомогою WikiData:

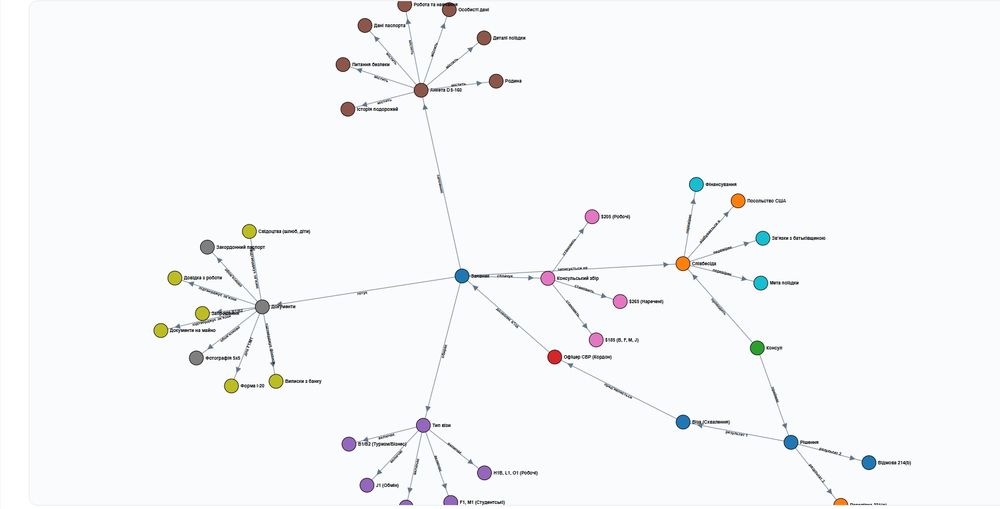

А ось приклад візуалізації сутностей і зв'язків для статті по запиту «віза в США»:

Процес роботи з сутностями автоматизований повністю, від визначення у конкурентів, до доопрацювання згенерованих статей за допомогою ШІ.

Скрипти на ШІ

Більше всього автоматизовано у мене генерація тексту, робота з сторонніми API і аналізу тексту. Як приклад - це збір і аналіз даних по індексації, пошук ботів Гугла на сайті, моніторинг даних, як то приклад цін у десятка конкурентів, щоб не пропустити моменту демпінгу.

В таких скриптах є схема, де дані спочатку отримуються ШІ, далі оброблюються і виводяться у вигляді дашборду. Це і дані з Google Search Console і з зовнішніх сайтів.

Також це використання кастомних чатботів в Gemini, де дані оброблюються на основі промптів для визначення EEAT на конкретних сторінках. Це зменшує в середньому час на аналіз сторінки в 5-7 разів. Такі боти не тільки перевіряють показники, але і дають конкретні рекомендації для доопрацювання сторінок.

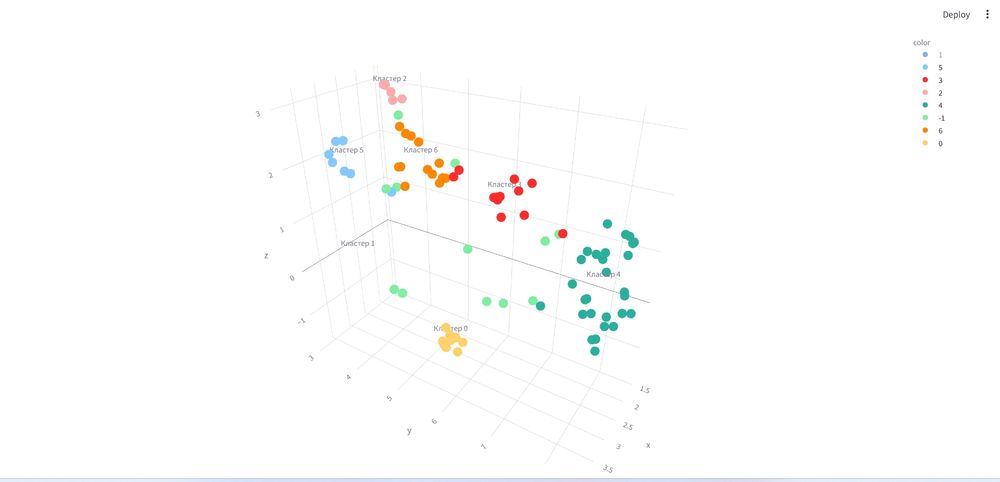

Приклад — за допомогою векторного представлення BERT аналізую наскільки тематичні кластери на сайті:

Кожна кулька — це окрема сторінка на сайті. Навіщо аналізувати це? Таким методом можна визначати важливі метрики siteFocusScore, siteRadius, siteEmbeddings і pageEmbeddings, які дозволяють оптимізувати тематичність сайту і отримати зростання по всім запитам. Також ці дані порівнюються з іншими значеннями, як то приклад API GSC — таким чином можна ще відмітити ті кластери, які застаріли та не дають трафіку.

Стосовно інших скриптів, то більшість скриптів — це консольні скрипти, які не мають інтерфейсу. Працюючи з programmatic seo, я оптимізував через WordPress REST API багато операцій, як то:

- Публікація статей (через API).

- Оновлення (наприклад додавання JSON-LD для сотен статей, які попередньо згенеровані ШІ).

- Парсинг даних конкурентів (наприклад для чого парсити семантику, якщо можна завантажити структуру у конкурента і отримати скелет, а вже потім допрацьовувати що є).

Резюмуючи — чим більше процесів ви оптимізуєте — тим менший шанс що вас замінить ШІ і тим більшу продуктивність ви можете отримувати. А продуктивність завжди конвертується в гроші. На початку автоматизації процесів не бажано пробувати створити комбайн, вирішуйте невеликі, але важливі задачі. Не цурайтеся допомоги ШІ, він хоч і робить помилки, але з ним все вийде і без знання мов програмування.

На ринку праці ваші інструменти — це можливість за пару годин робити те, на що інші витратять всі 8 годин. Тому пробуйте автоматизувати і все у вас вийде.

Авторизуйтесь , щоб залишати коментарі